IREX - étude comparative des solutions open source de complétion de code alternatives à TabbyML

Étude comparative des solutions open source altern

1. Introduction

TabbyML est une solution open source d'assistance et de complétion de code basée sur l'IA, populaire pour sa rapidité et sa compatibilité avec différents langages de programmation. Cependant, plusieurs alternatives open source émergent, offrant des fonctionnalités similaires avec des spécificités adaptées aux environnements CPU et à l’auto-hébergement.

2. Pourquoi explorer des alternatives à TabbyML ?

- Compatibilité CPU : certaines solutions sont plus légères et fonctionnent sans GPU.

- Facilité de déploiement : certaines alternatives peuvent être déployées rapidement via Docker ou directement sur un serveur.

- Licence et personnalisation : open source signifie souvent plus de liberté pour personnaliser le modèle.

- Performance et spécialisation : certains modèles sont optimisés pour la complétion de code dans des langages spécifiques.

3. Fonctionnalités clés des solutions alternatives

- Auto-hébergement : possibilité de déployer le modèle sur un serveur local.

- Compatibilité multi-langages : support des langages les plus courants (Python, JavaScript, Go, C++, etc.).

- Mode CPU : certaines alternatives fonctionnent efficacement même sans GPU dédié.

- Interfaces simplifiées : API ou intégration directe avec les IDE comme VS Code ou Neovim.

- Mises à jour et communauté : large communauté open source permettant de bénéficier de correctifs et d’améliorations régulières.

4. Présentation des différentes solutions

-

CodeGeeX : modèle multi-langages (Python, Java, C++, Go…), optimisé pour CPU, facile à déployer via Docker.

🔗 Projet GitHub -

WizardCoder : dérivé de StarCoder, optimisé pour la complétion de code, supporte plusieurs langages, auto-hébergeable via Docker ou scripts.

🔗 Projet GitHub -

CodeT5 : modèle basé sur T5, multi-langages, adapté aux projets collaboratifs, supporte un usage CPU.

🔗 Projet GitHub -

StarCoder : modèle issu du projet BigCode, multi-langages, optimisé pour la complétion de code, open source et auto-hébergeable.

🔗 Projet GitHub -

Aider : assistant open source pour édition et complétion de code en contexte, déployable en local.

🔗 Projet GitHub -

Continue : alternative open source à Copilot, intégrée à VS Code / JetBrains, auto-hébergeable via serveur local.

🔗 Projet GitHub -

CodeGenius : assistant open source de génération et complétion de code, auto-hébergeable avec Docker.

🔗 Projet GitHub -

FireCoder : assistant AI auto-hébergeable, conçu pour optimiser l'expérience de codage local.

🔗 Projet GitHub

5. Tableau comparatif par rapport à TabbyML

| Solution | Déploiement CPU | Langages supportés | Auto-hébergeable | Type | Facilité de déploiement | Commentaires | Licence | Taille CM | Forks | Followers | MR dernière année |

|---|---|---|---|---|---|---|---|---|---|---|---|

| TabbyML | Partiel (préférable GPU) | Multi-langages | Oui | Assistant IA | Moyen | Très performant, nécessite GPU | Apache 2.0 | 32k | 1.6k | 141 | 910 |

| CodeGeeX | Oui | Multi-langages | Oui | Modèle IA | Docker facile | Communauté active | Apache 2.0 | 8.6k | 662 | 91 | 21 |

| WizardLM | Oui | Multi-langages | Oui | Modèle IA | Docker / Script | Optimisé code | Apache 2.0 | 9.5k | 735 | 109 | 12 |

| WizardCoder | Oui | Multi-langages | Oui | Modèle IA | Docker / Script | Optimisé code | Apache 2.0 | 9.5k | 735 | 109 | 12 |

| CodeT5 | Oui | Multi-langages | Oui | Modèle IA | Docker / Script | Collaboratif | BSD-3-Clause | 3.1k | 479 | 45 | 5 |

| StarCoder | Oui | Multi-langages | Oui | Modèle IA | Docker / Script | BigCode performant | Apache 2.0 | 7.4k | 528 | 71 | 7 |

| Aider | Oui | Multi-langages | Oui | Assistant IA | Script / Docker | Édition contextuelle | Apache 2.0 | 37k | 3.4k | 216 | 179 |

| Continue | Oui | Multi-langages | Oui | Extension + serveur | Facile (IDE intégré) | Alternative Copilot | Apache 2.0 | 28.6k | 3.4k | 124 | 2.246k |

| CodeGenius | Oui | Multi-langages | Oui | Assistant IA | Docker | Génération & complétion | MIT | 2 | 0 | 1 | 0 |

| FireCoder | Oui | Multi-langages | Oui | Assistant IA | Docker | Expérience locale | MIT | 42 | 2 | 2 | 28 |

6. Évaluation comparative et scoring des modèles IA

Pour faciliter le choix du modèle le plus adapté à implémenter, nous avons mis en place un système de scoring basé sur quatre critères principaux :

- Taille de la communauté : nombre de membres, watchers ou contributeurs actifs. Pondération : 30%

- Nombre de forks : nombre de copies ou modifications du projet par d'autres développeurs. Pondération : 20%

- Nombre de followers : le nombre de personnes suivant le projet ou ses contributeurs principaux. Pondération : 20%

- Nombre de merge requests (MR) dans la dernière année : indicateur d'activité récente et de maintien du projet. Pondération : 30%

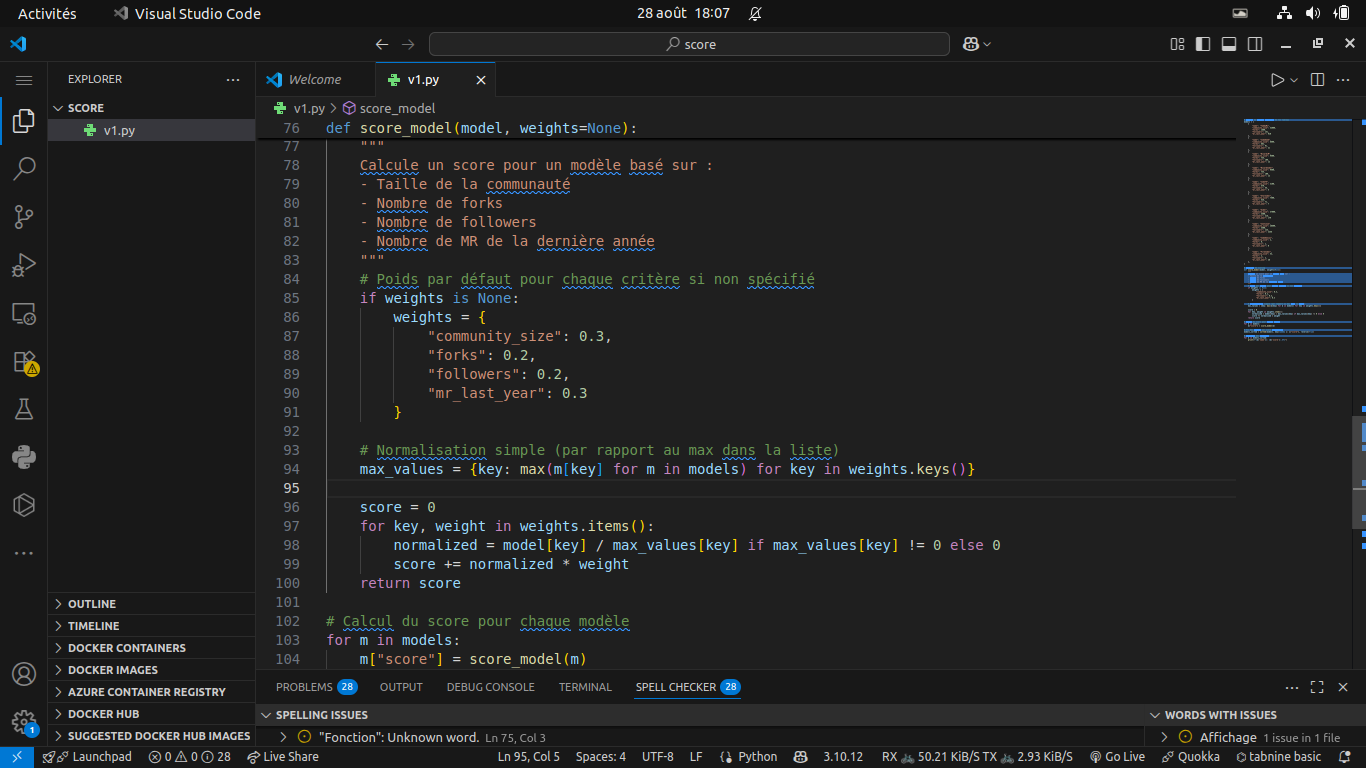

Le scoring est calculé en Python. Chaque critère est normalisé par rapport au maximum parmi tous les modèles pour garantir une comparaison équitable. Ensuite, chaque critère est multiplié par sa pondération respective, et la somme pondérée fournit le score final de chaque modèle.

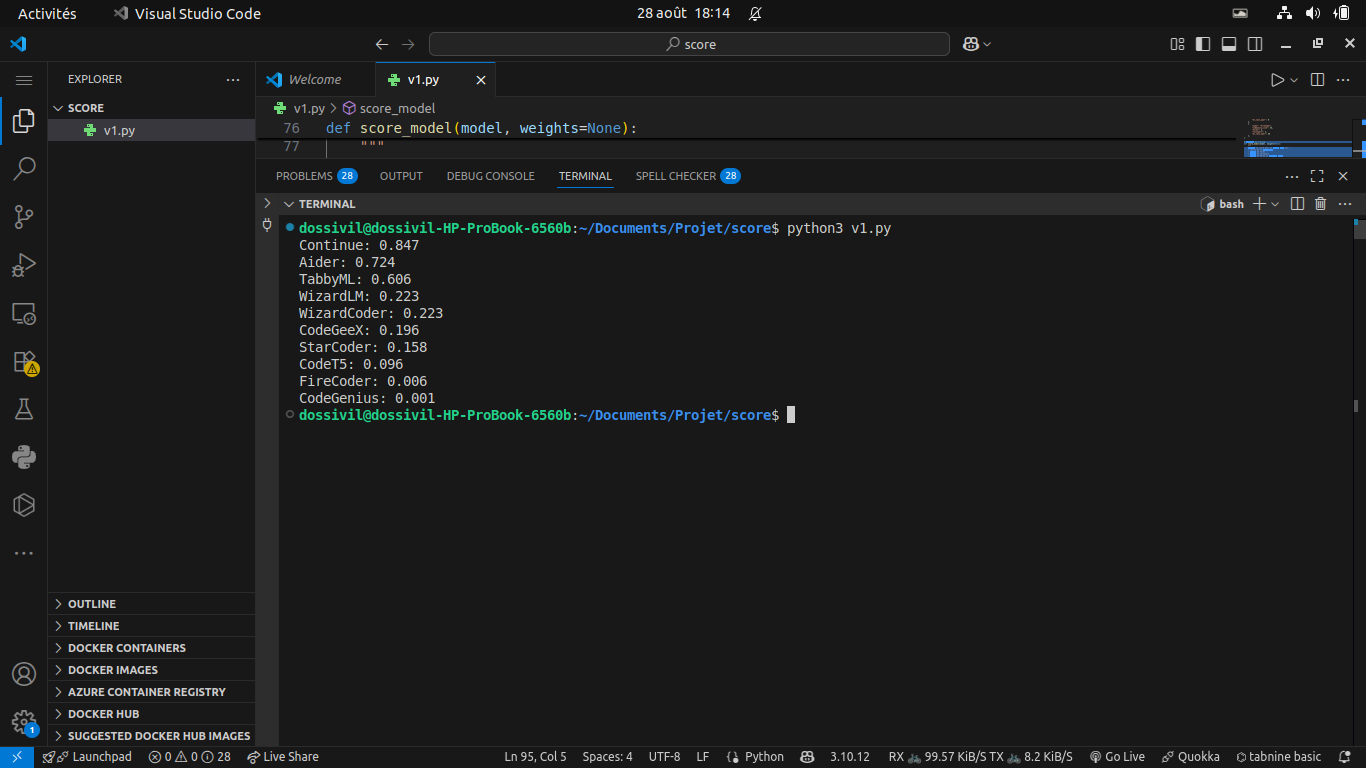

Cette approche permet de classer les modèles selon leurs performances globales sur ces critères, et d'identifier rapidement celui qui est le plus pertinent pour un projet donné.

Fonction de scoring

7. Résultats et visualisation

D’après ces résultats, le modèle jugé le meilleur est Continue, avec le score le plus élevé de 0,847. Cela reflète la combinaison la plus forte de communauté active, de forks, de followers et de merge requests réalisées au cours de la dernière année.

No comments yet. Start a new discussion.